<p>SEOというもの全体に対する理解を深め、さらにSEO対策チームとの連携をスムーズにすることを可能にするために、BrightEdgeでは、今回から3回連続でSEOにおける基本的概念や関連のある言葉の意味をご紹介します。SEO関連の専門用語は星の数ほどありますが、このシリーズでは最も頻繁に使用される基本的用語に的を絞ってご紹介したいと思います。</p>

<p>3回シリーズのパート1では、自社サイトのページ上に存在する要素、つまり<strong>「オンページ要因」</strong>に関するSEOの基本や専門用語の意味を取り上げます。</p>

<h2>SEOの基本となるページコンテンツ</h2>

<p><strong>オンページ テキスト</strong><br />

オンページ テキストとは、ページ作成者が読み手を対象に作成し、ウェブページ上に掲載している文章のことを指します。読み手に価値ある情報を提供することを目的としてオンページ テキストを作成します。検索エンジンのクローラーは、ここに何が書かれているのか把握するために文章での情報を必要としているため、以下にご紹介するような内容を必ず記載するようにしましょう。</p>

<p><strong>ワード数</strong><br />

ウェブページ上での使用ワード数について絶対的な基準があるわけではありませんが、一般的には、英単語では1ページあたり少なくとも500ワード以上、理想的には2,250ワード程度のワード数を使用することが好ましいと考えられています。しかし、使用ワード数は、取り上げるトピックやページの目的でも大きく変動します。自社にとって重要な内容や、SEOでより重点を置いているページでは、ページ上のワード数は多くなって当然です。ちなみに、Googleでは内容が薄いページに対する評価は厳しいため、ワード数を稼ぐために関係のない文章を無理やり使用してコンテンツの嵩増しをすることは避け、価値ある情報をわかりやすく提供することを心がけましょう。</p>

<p><strong>アバブ ザ フォールドのテキスト</strong><br />

検索エンジンのクローラーは、ウェブページ上のコンテンツをページの上部から順番に読んでいます。クローラーのこの習性を考慮すると、ページ上部に重要な文章を集中させることが効果的であると言えるでしょう。SEO業界では、画面をスクロールすることなくすぐに表示されるようなページ上部のことを「アバブ ザ フォールド」と一般的に呼んでいます。実際のコンテンツが表示される前に大きな画像が表示されたり、複数の広告が表示されたりすると、場合によってはGoogleによってペナルティが課される可能性もありますので注意が必要です。</p>

<p><img alt="Guide to SEO basics and how to succeed" class="alignleft wp-image-18056" height="243" sizes="(max-width: 290px) 100vw, 290px" src="https://www.brightedge.com/blog/wp-content/uploads/2018/05/html-basics-…; srcset="https://www.brightedge.com/blog/wp-content/uploads/2018/05/html-basics-… 500w, https://www.brightedge.com/blog/wp-content/uploads/2018/05/html-basics-… 150w, https://www.brightedge.com/blog/wp-content/uploads/2018/05/html-basics-… 300w" width="290" /></p>

<p><strong>キーワード</strong></p>

<p>キーワードとは、検索を行うユーザーが、自社の製品やサービスを求める際にGoogleやBingなどの検索エンジンに入力することが考えられる単語のことを指します。検索の際に複数の単語を組み合わせる場合は、<strong>キーワードフレーズ</strong>と呼びます。</p>

<p>オンページ テキストやメタ情報(これについては後程詳しくご紹介します!)にキーワードを戦略的に使用することは、自社サイトのビジビリティーを高めるための基本的かつ効果的な手法です。このようにキーワードをページ上で効果的に用いることによって、特定のクエリが入力された時の検索エンジン結果ページ(SERP)に自社ページが表示される可能性が高まり、また選択したキーワードに対する自社ページのランキング状況を改善することもできます。</p>

<p>コンテンツ最適化を目的としたキーワード戦略を導入すると、選択したキーワードがオンページ テキスト上に均等に使用され、読み手にとっても自然な文章の流れを再現することができます。ちなみに全体のワード数の10%以上をターゲットキーワード(選択したキーワード)が占めるような状況をキーワード スタッフィングと呼び、キーワードを不自然に使用しすぎている好ましくない状況であると判断されます。BrightEdgeではキーワードが全体の3~5%になるよう調整することをお勧めしています。</p>

<p><strong>ロングテール キーワード</strong></p>

<p>検索時に3ワード以上のワードを使用する際の検索クエリをロングテール キーワード(またはロングテール クエリ)と呼びます。ロングテール クエリは、トラフィックを効果的に獲得する素晴らしいチャンスだと考えられています。なぜなら、1,2語のキーワードを用いた検索時に比べて、ロングテール キーワードを使用した検索は、ユーザーの検索意図がよりはっきりとしている可能性が高いため、より検索ユーザーの意図と関連度の高い結果を表示できる可能性も高まると考えられているからです。これを考慮すると、1,2語のキーワードや、業界で頻繁に使用されている競争率の高いキーワードを意識したコンテンツ作りをするよりも、ロングテール クエリに対応するようなページコンテンツを作成することによって、コンバージョンをより効果的に高めることができ、またオーガニック検索由来のトラフィックの拡大も可能になるはずです。</p>

<p><strong>重複したコンテンツ</strong></p>

<p>重複したコンテンツとは、文字通り自社サイト上または他のサイト上など場所を問わず重複したコンテンツが複数ある状態を指します。</p>

<p>重複したコンテンツを抱えてしまう理由としては、サイト上でメタ情報(これについては後程詳しくご紹介します)などをうっかり同じ情報を用いて繰りかえしてしまった可能性が考えられます。その他の理由としては、印刷限定のページ(例:PDF)や、他のページに表示/リンク付けされているEコマース商品ページ、またはモバイルフレンドリー専用に同じページを作成した場合などが考えられます。</p>

<p>自社サイト上に重複したコンテンツを作成することがどうしても必要な場合は、検索エンジンに重複したページのうちどちらのページを検索結果ページに優先して表示させてほしいのか検索エンジンにアピールする方法もあります(ちなみにこの手法は「正規化」と呼ばれています)。</p>

<p>サイト上に重複したコンテンツがある場合、検索結果から除外されるだけで済む場合もありますが、他サイトからコンテンツを真似たため重複したコンテンツがある場合や、検索結果ページのランキング上位を獲得するために同じコンテンツを複数作成していると判断された場合などは、Googleによるペナルティが課される可能性もあります。</p>

<h2>メタ情報</h2>

<p><strong>メタ情報</strong></p>

<p>メタ情報(別名メタデータとしても知られる)とは、サイト上のページが何についてのページなのか検索エンジンが判断するために検索エンジンが参照する情報のことを指します。また検索エンジンの検索結果ページに各ページを表示する際に表示される情報もメタ情報に基づいて表示されます。メタ情報の中でもとりわけ重要なのは、「タイトル」と「ディスクリプション」です。</p>

<p><strong>メタタイトル/タイトルタグ</strong></p>

<p>メタタイトル/タイトルタグとは、このページではどのような内容を取り上げているのか説明するための1文のことを指します。メタタイトルは、検索結果ページに表示されるリスティングの説明文として表示され、読み手にリスティングをクリックしてもらうための重要な役割を果たしています。したがって、キーワードを使用しているか、長さは適切か、ユニークさはあるかなどの点を考慮して効果的なメタタイトルを作ることが求められます。ページのメタタイトルを最適化するにはベストプラクティスとして以下のような点に注目しましょう。<br />

<img alt="Guide to SEO basics and meta data" class="alignright wp-image-18058" height="272" sizes="(max-width: 411px) 100vw, 411px" src="https://www.brightedge.com/blog/wp-content/uploads/2018/05/seo-basics-p…; srcset="https://www.brightedge.com/blog/wp-content/uploads/2018/05/seo-basics-p… 500w, https://www.brightedge.com/blog/wp-content/uploads/2018/05/seo-basics-p… 150w, https://www.brightedge.com/blog/wp-content/uploads/2018/05/seo-basics-p… 300w" width="411" /></p>

<p> </p>

<ol>

<li>ページ上で特に重要なプライマリ キーワードを1つまたは2つ使用する</li>

<li>スペースを含め55語(半角)以内に抑える</li>

<li>メタタイトルが長い場合は、…のようにピリオドを複数回使用して、メタタイトルを短くする</li>

</ol>

<p> </p>

<p>またフォントサイズを大きくしたり、大文字を使って単語を省略表記したりすることによって効果的にメタタイトルを短くすることもできます。ページの内容を上手く表すメタタイトルを作ることによって、ユーザーにとってリスティングを選びやすくなることはもちろんのこと、重複したコンテンツを避けることにもつながります。</p>

<p>効果的なSEOタイトルタグの作成方法については<strong><a data-wpel-link="internal" href="https://www.brightedge.com/blog/the-seo-title-tag/" rel="follow">こちら</a></strong>をご覧ください(英語のみ)。</p>

<p><strong>メタディスクリプション</strong></p>

<p>メタディスクリプションとは、検索結果ページでメタタイトルに続いて表示されるテキストのことを指します。メタディスクリプションは、ウェブページの内容を表します。メタディスクリプションは、検索結果ページ上で最大156字(スペースを含む)表示されるため、検索結果ページ上で最も多くのスペースを占めます。メタタイトルと同様に、メタディスクリプション作成時には、ページを上手く正確に表すテキストを作成することが求められます。メタディスクリプションもユーザーがリスティングをクリックする大きな後押しをする要因であり、キーワードを効果的に使用できるようキーワードの最適化を行うことが重要になります。</p>

<p>効果的なSEOメタディスクリプションを作成するための5つのポイントついては<strong><a data-wpel-link="internal" href="https://www.brightedge.com/blog/meta-description-tips-2018/" rel="follow">こちら</a>をご覧ください(英語のみ)。</strong></p>

<p><strong>メタキーワード</strong></p>

<p>メタキーワードとは、コンマ(,)を使ってページ上で扱うキーワードをリスト表記したものを指します。Googleでは、メタキーワードは参照していないと言われていますが、外国版サイトでは現在でもメタキーワードが参照されていると考えられています。</p>

<h2>ページコンテンツの最適化</h2>

<p>ページ上にある要素、つまりオンページ コンテンツに視覚的な重要度が分かるような工夫をしてページの構造を整理することによって、読み手にとって読みやすいページ作りが可能になり、また検索エンジンにとってもページの内容を把握しやすくなります。ページ上のテキストを重要度別に整理するのに最も基本的な手法は、<strong>ヘディング タグ</strong>の使用です。</p>

<p><strong>ヘディングタグ</strong></p>

<p>ヘディングタグとは、ウェブページ上のコンテンツの構造を表すために用いられる文字列のことを指します。ヘディング タグを活用することによって、ページ上のテキストを重要度別に構造化することができ、検索エンジン、読み手のいずれにとっても視覚的にわかりやすくなります。</p>

<p><strong>H1タグ</strong></p>

<p>H1タグとは、ウェブページ上で最も重要な「見出し」のことを指します。新聞で例えると、一面の見出しのようなものです。通常H1タグは、ウェブページ上で最も大きく読み手の視野に入りやすい場所にあります。H1タグに関するベストプラクティスとしては、ページ上で使用するH1タグの数は1つだけに限定するということです。</p>

<p><strong>H2タグ / H3タグ</strong></p>

<p>H1タグを「傘」のようなものであるとすれば、H2タグ(サブヘディング)は、H1タグの下に配置します。H1タグがページ上で最も重要な見出しなら、H2タグは、その次に重要な見出しです。またH3タグも同様に、H1、H2タグの見出しに比べて重要度が低いものとしてこれら2つのタグの下に位置づけます。</p>

<p><strong>ヘディングタグの重要度(H1~H6まで)</strong></p>

<p>前述の通り、H1がウェブページ上で最も重要な見出しであるとすれば、H6は最も重要度が低い見出しであると捉えます。多くのウェブページでは、通常H1~H3タグが使用されます。重要な点としては、ヘディングタグの文字数(スペースも含む)も文字数として忘れずにカウントしましょう。ヘディングタグを使用しすぎると、コンテンツの流れが悪くなり、かえって読み手に取って読みづらくなりますので注意が必要です。</p>

<p><strong>リッチメディア</strong></p>

<p>リッチメディアとは、画像や動画のことを指し、昨今ユーザーの要望が非常に高まっているメディアであり、検索結果ページでのビジビリティーを高めるためのベストプラクティスでも注目されています。リッチメディアは、ウェブトレンド全体で重要視されているため、オンページ コンテンツの最適化戦略の一環として、ページ上の文章に加えて画像や動画を組み込むことをお勧めします。</p>

<p>しかしながら、検索エンジンのクローラーは、画像や動画などのリッチメディアを「見る」ことはできるものの、様々な資料を参照することが必要になり、クロールバジェットを浪費してしまうことに繋がります。そこでリッチメディアの対策として、テキストと同様に、タイトルや、ディスクリプション、タグなどを用いることをお勧めします。このような対策によって、Google画像検索や動画検索をはじめ、YouTube(YouTubeを個別のチャネルとして使用している場合や、オンページ コンテンツとしてYouTubeにリンクを張っている場合)でのビジビリティーを高めることも可能になります。</p>

<p>リッチメディアに関して最も重要な点としては、リッチメディアの内容をオンページ テキストと一致させるということです。オンページ テキスト内で用いられているブランド キーワードやその他の関連キーワード、メタ情報内で使用したキーワードなどと同じキーワードをリッチメディアにも使用しましょう。</p>

<p><strong><a data-wpel-link="internal" href="https://www.brightedge.com/blog/youtube-seo/" rel="follow">YouTube SEOで成功を収める方法</a></strong><a data-wpel-link="internal" href="https://www.brightedge.com/blog/youtube-seo/" rel="follow"><strong> SEO</strong></a>や<a data-wpel-link="internal" href="https://www.brightedge.com/blog/art-image-optimization/" rel="follow"><strong>画像SEOを効果的に実践する方法</strong></a>についても併せてご覧ください(英語のみ)。</p>

<p><strong>画像の最適化</strong></p>

<p>画像を最適化する際に注意すべき要因は様々あるのですが、とりわけ最も重要なのが「画像タイトル(ファイル名)」と「ALT属性(別名ALTテキスト)」です。</p>

<p><strong>画像タイトル/ファイル名</strong></p>

<p>ファイル名は、画像のタイトル的な存在で、画像が何を表しているのか簡潔にわかりやすく説明する必要があります。何よりも簡潔さが求められ、スペースの代わりにハイフン( - )を用い、すべて小文字で表記する必要があります。例えば「赤い靴(Red Shoe)」を表す場合は、Red_Shoeよりもred-shoeと表記する方が好ましいとされています。</p>

<p><strong>ALTテキスト</strong></p>

<p>ALTテキストとは、画像を表す代替文章のことを指します。画像が何を表しているのか文章で画像の内容を表します。ALTテキストは、視覚障害があり、スクリーンの内容を聴覚に頼って把握するユーザーにとって重要になります。ここでもやはり簡潔さが求められ(スペースを含めて100文字以内)、ユニークさと正確さが重要になります。</p>

<p><strong>動画の最適化</strong></p>

<p>画像と同様に、動画の最適化でも最も重要になるのは、動画のタイトル、ディスクリプション、タグです。</p>

<p>ページ上に表示する動画のタイトルは、ページのメタタイトルと同様に、簡潔で動画の内容を正確に表しているタイトルであることが重要です。またページ上のコンテンツやメタ情報で使用されている関連キーワードを適切に(過剰にならない程度に)使用しましょう。</p>

<p><img alt="Guide to seo basics and rich media, videos" class="alignleft wp-image-18059" height="316" sizes="(max-width: 315px) 100vw, 315px" src="https://www.brightedge.com/blog/wp-content/uploads/2018/05/SEO-basics-p…; srcset="https://www.brightedge.com/blog/wp-content/uploads/2018/05/SEO-basics-p… 500w, https://www.brightedge.com/blog/wp-content/uploads/2018/05/SEO-basics-p… 150w, https://www.brightedge.com/blog/wp-content/uploads/2018/05/SEO-basics-p… 300w" width="315" /><br />

メタディスクリプションと同様に、ページ上に表示する動画のディスクリプションも文字数では若干余裕があるため、動画の内容をより詳しく説明することができます。注意する点は動画タイトルと同じですが、動画のディスクリプションでもオンページ テキストやメタ情報内で使用されている関連キーワードを効果的に使用することが求められます。</p>

<p><strong>タグ</strong></p>

<p>タグとは、1単語または2単語で構成されるウェブページのカテゴリーです。自社ブランドやその他重要キーワードをオンページ テキストやメタ情報と絡めて効果的にアピールすることができます。</p>

<p>基本的SEO対策ガイド(パート1)は以上です。<a data-wpel-link="internal" href="https://www.brightedge.com/jp/articles/guide-to-basic-seo-concepts-part…; rel="follow">パート2 </a>では引き続きSEOで重要なコンセプトや検索エンジンの要素についてとりあげ、<a data-wpel-link="internal" href="https://www.brightedge.com/jp/articles/guide-to-basic-seo-concepts-part…; rel="follow">パート3</a>ではさらに掘り下げてSEO対策で非常に重要な専門的知識をご紹介しますので、是非ご覧ください。</p>

Before joining BrightEdge, Michael honed his SEO skills in several places after getting his start as a digital strategist in 1996. Based out of Tulsa, he contributed his marketing skills at a variety of local brands, most notably PennWell Publishing. At PennWell, Michael worked in several roles, including digital media product management, SEO and search marketing manager, and finally as director of SEO and product support. As director of SEO, a role he held for ten years, he defined an enterprise SEO strategy for an astounding 118 websites across 10 different industries. The strategy he developed led the brand to growth in SEO of 1,187%. He also created and led a social media steering committee to provide management of a multi-site social strategy and a content taxonomy to organize and tag the content published across those sites. Michael joined the BrightEdge team in 2016. As part of our team he became a key contributor and one of the most experienced working SEOs within the organization, bringing that experience to the planning and development of our Content Optimizer customers for on and off-page SEO auditing and optimization.

Before joining BrightEdge, Michael honed his SEO skills in several places after getting his start as a digital strategist in 1996. Based out of Tulsa, he contributed his marketing skills at a variety of local brands, most notably PennWell Publishing. At PennWell, Michael worked in several roles, including digital media product management, SEO and search marketing manager, and finally as director of SEO and product support. As director of SEO, a role he held for ten years, he defined an enterprise SEO strategy for an astounding 118 websites across 10 different industries. The strategy he developed led the brand to growth in SEO of 1,187%. He also created and led a social media steering committee to provide management of a multi-site social strategy and a content taxonomy to organize and tag the content published across those sites. Michael joined the BrightEdge team in 2016. As part of our team he became a key contributor and one of the most experienced working SEOs within the organization, bringing that experience to the planning and development of our Content Optimizer customers for on and off-page SEO auditing and optimization. Michael remembered

Michael remembered Lemuel Park, BrightEdge co-founder and CTO, had this to say:

Lemuel Park, BrightEdge co-founder and CTO, had this to say:

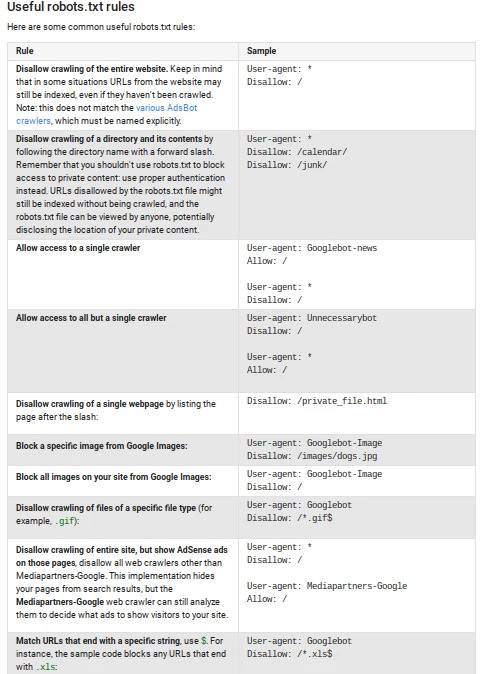

Although robots.txt looks simple, there are a few rules that must be followed to ensure that the code will be interpreted properly.

Although robots.txt looks simple, there are a few rules that must be followed to ensure that the code will be interpreted properly.